Centrele secrete unde Facebook se ocupă de cenzură

În 25 februarie 2019 Eldiario.es a publicat un articol în care se fac dezvăluiri despre modul în care are loc cenzura postărilor de pe Facebook.

Într-un birou fără ferestre sute de persoane stau cu privirea fixată într-un ecran timp de 8 ore pentru a analiza mizeriile umanităţii şi a decide ceea ce poate fi văzut şi ce nu. Acesta este „bunkerul” Facebook din capitala Poloniei, Varşovia, unul dintre cele 20 de centre care există în lume pentru a administra cenzura asupra comentariilor, video-urilor şi fotografiilor pe care 2.271 milioane de persoane le publică în fiecare zi.

Eldiario.es a avut acces la surse din centrele din Varşovia şi Lisabona şi la documente care arată condiţiile în care se iau deciziile asupra reţelei de conţinuturi cu cel mai mare impact din lume. Insulte, droguri, abuzuri sexuale, terorism, decapitări. Există un mit epic tehnologic despre algoritmi care elimină automat conţinutul necorespunzător pe Facebook. În spatele acestei idei moderne şi aseptice de cenzură există, în realitate, peste 15.000 de revizori de conţinut, persoane care se dedică să filtreze excesele făcute de jumătate din lume. Albert sau Johan sunt doi astfel de „cenzori” care din experienţa lor subliniază arbitrariul normelor conform cărora se decide ceea ce se publică sau ce nu se poate publica. „Este imposibil să nu faci greşeli, deoarece sistemul este foarte contradictoriu.”

Munca celor care filtrează conţinutul din Facebook este confidențială şi, de asemenea, precară. „Cenzorii” din centrele din Varşovia sau Lisabona încasează un salariu în jur de 700 € pe lună şi sunt subcontractați prin firme de consultanţă internaţională, cum ar fi Accenture sau agenţiile de angajare temporară. Ei nu pot spune nimănui că lucrează pentru Facebook, la care, în scris, se referă întotdeauna ca fiind „client”.

Pentru a furniza datele pe baza cărora s-a realizat acest reportaj, trei persoane cu experienţă în această muncă au cerut să le fie protejată identitatea şi să le ascundem numele lor reale. Un revizor de conţinut este întotdeauna supravegheat: dacă cineva scoate telefonul din buzunar sau o sticlă cu apă, acesta va fi sancţionat de şefi; există un sistem care face ca lucrătorii să se denunţe reciproc în schimbul unor premii pentru bun comportament. Pentru întreaga zi lucrătoare, au un timp de odihnă de 30 de minute, pe care este necesar să îl administreze de-a lungul zilei pentru a mânca, pentru a merge la baie, pentru a-şi întinde picioarele; dacă cineva consumă 20 de minute ca să mănânce, este bine să nu aibă o problemă de stomac în acea zi, deoarece ar depăşi cu uşurinţă limita stipulată.

Aşa funcţionează revizuirea conţinutului

Echipele de lucru sunt împărţite în funcţie de tipul de conţinut şi de limbă. În Varşovia şi Lisabona a fost filtrat conţinutul în limba spaniolă în ultimii ani. Ulterior a fost deschis un birou și la Barcelona.

Fiecare moderator are la postul său un ecran care îi arată cazurile de conţinut de pe Facebook care acumulează mai multe „denunţuri” de la utilizatorii care le consideră nepotrivite. De fiecare dată când un anumit număr de persoane denunţă („raportează”, în limbajul Facebook) un conţinut, acesta ajunge la unul dintre aceste ecrane. Există două opțiuni: „Şterge” pentru a şterge conținutul, sau „Ignoră” pentru a lăsa postarea.

„Analizăm între 400 şi 600 de cazuri pe zi. Avem 30 de secunde pentru a decide în fiecare caz. Nu întotdeauna ai timp să iei decizia corectă”, explică Johan.

Există un document de instruire pentru noii angajaţi ai echipei de moderare Facebook, la care a avut acces eldiario.es. Am discutat cu Johan şi Albert ce ar fi de făcut în fiecare caz, conform experienţei lor.

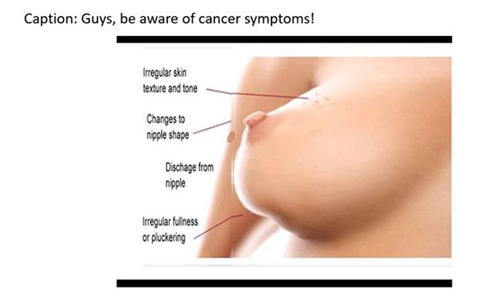

„Acordaţi atenţie simptomelor cancerului”, spune imaginea.

În acest caz, în ciuda faptului că Facebook nu permite imagini cu sfârcuri în reţeaua sa socială cu un algoritm automat care a început deja să funcţioneze (şi care, uneori, şterge în mod eronat operele de artă clasică în care apare sânul unei femei), conform normelor moderatorul este necesar să deblocheze şi să publice conţinutul, deoarece este o imagine informativă despre sănătate şi nu o imagine a unui nud explicit sau pornografic.

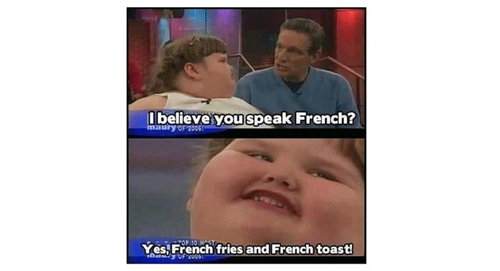

În astfel de cazuri, moderatorul este nevoie să decidă bine într-un timp foarte scurt. Mai întâi este necesar să caute pe Google la ce se referă această memă. Este un caz de agresiune a copilului? Va găsi că dialogul redat în imagini este real şi face parte dintr-un interviu televizat cu o fată despre obezitatea ei. Dar obezitatea nu este considerată o dizabilitate. „A ofensa pe cineva nu este un motiv să ştergi nimic, cu excepţia cazului în care este considerat un grup protejat, cum ar fi persoanele cu handicap, dar obezitatea nu este o dizabilitate, aşa că ar fi necesar să ştim dacă fata are vreun fel de problemă psiho-mentală.” Este nevoie să decidă în 30 de secunde. Johan ar marca „Ignore”.

Există o anumită categorie pe Facebook pentru a eticheta tot conţinutul care invită la auto-leziuni. În teorie, cu normele în mână, ar fi un caz de eliminare. Dar Johan subliniază: „Deoarece este un desen, susceptibilitatea este alta, există multe imagini de genul acesta pe Facebook care nu se şterg. Dacă vedem mai multe de acest gen, atunci avizăm superiorii ca să notifice autorităţile”, ceva ce se petrece numai cu conturile unor ţări.

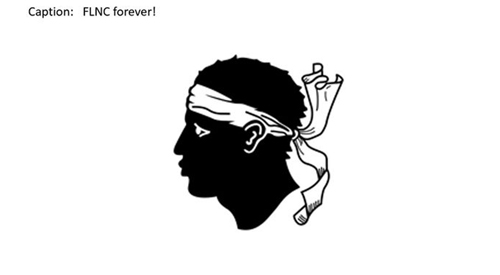

„Îmi amintesc acest caz”, spune Johan. „Este logo-ul Frontului Naţional de Eliberare din Corsica. Din anumite motive, într-o sesiune de formare săptămânală ni s-a spus că este o organizaţie teroristă, dar să nu-l marcăm cu o ştergere pentru terorism, care este o etichetă în sistemul său de revizuire, ci ca o ştergere generală fără a specifica de ce.” FLNC a renunţat la activitatea armată în 2014. (…)

Acestea sunt cazuri mai mult sau mai puţin simple, de antrenare, care arată că deciziile sunt complexe. Regulile generale ale Facebook sunt publice, generale şi extinse, într-un exerciţiu recent de transparență, care totuşi se contrazice cu rutina de lucru din centrele de filtrare. Din lipsa timpului sau a calificării, Facebook încearcă să impună lucrătorilor săi reguli interne stricte pentru fiecare caz posibil, atât de precise încât uneori devin arbitrare.

Moderatorii Facebook primesc în mod constant cazuri de utilizatori care insultă femeile în general sau pe vreuna în special. În acest caz, standardul public al Facebook este clar: „Nu sunt permise atacuri prin termeni denigratori legaţi de activităţi sexuale (de exemplu, târfă, căţea)”. Totuşi, aici întâlnim una dintre acele reguli nescrise denunţată de lucrători. „Dacă cuvântul căţea este scris într-o imagine, sau la fotografia unei femei, ca într-o memă, este şters, dar dacă o fată este etichetă drept curvă/căţea în comentariul unui post, nu se şterge.” De ce? „Ei bine, nu ştiu, asta cere clientul şi este necesar să respectăm regulile”, spune Albert.

Hitler nu, Franco da

„Dacă o persoană face comentarii pentru a-l lăuda pe Hitler, este ştearsă. Acelaşi comentariu făcut de un spaniol pentru a-l lăuda pe Franco este lăsat”, explică Albert despre ceea ce se petrece (cel puţin la sediul Facebook din Varşovia). „Fascismul este permis de Facebook”, spune Johan, unul dintre lucrătorii care a rezistat cel mai mult în acest birou. „Puteţi pune o pagină plină cu fotografii ale lui Mussolini sau Franco şi nu se petrece nimic, este permis în totalitate”, continuă el.

Potrivit surselor cu experienţă în biroul din Varşovia, compania a ezitat în trecut asupra modului în care să trateze conţinutul legat de Hitler. „Mai întâi, ne-au spus că nu se şterge nicio fotografie sau comentariu asupra lui Hitler; apoi ne-au spus să îl marcăm ca fiind «deranjant» [conținut pe care minorii nu este permis să îl vadă], şi apoi ne-au spus să îl ştergem de tot”, explică el.

María, o altă sursă consultată de eldiario.es, care a lucrat o lună în biroul de la Lisabona în 2017, spune că norma nu făcea teoretic distincţii între Franco sau Hitler. „Dar este adevărat că, în ceea ce îl privește Hitler şi nazismul sunt super-rigizi. Nu se pot posta fotografii de-ale lor fără să spui numele sau cine sunt. Dacă postaţi doar o imagine cu numele şi nu spuneţi «dictator» sau nu denunţați puţin ce a făcut, este nevoie să o eliminăm pentru că Facebook simte că îl lăudaţi”.

Uneori lucrătorii au pus întrebări cu privire la aceste contradicţii. „Şefii îţi explică, desigur, unde pun limita. Că dacă vom începe să ştergem… unde spunem suficient. Este scuza pe care o invocă”, spune Albert. Apologia franchismului nu este o crimă în Spania, apologia nazismului este o crimă în Germania, dar regulile Facebook sunt libere, nu depind de legile fiecărei ţări în care au utilizatori. Se adaptează numai la fiecare limbă, însă politica de conţinut a Facebook este globală şi poartă ştampila americană. (…)

Geopolitică în fiecare conţinut

Atât Albert, cât şi Johan subliniază standardele duble şi o protecţie mai mare pentru anumite grupuri, indiferent de ce spun normele scrise. „Insultarea anumitor convingeri sau ideologii în unele situații este permisă, în altele nu. Există anumite credinţe sau ideologii care sunt protejate în mod special pe Facebook.” Primul, după experienţa lui Albert şi Johan, este „sionismul”. Cel puţin în biroul din Polonia, unde exterminarea evreilor în timpul nazismului a fost deosebit de tragică. Potrivit mărturiei sale, pe Facebook orice critică împotriva sionismului sau a politicii Israelului în Palestina riscă să fie identificată ca antisemitism. Apelul la boicotul Israelului pentru acţiunile sale în Palestina este interzis. „Campaniile Mişcării Boycott, Divestment and Sanctions (BDS) sunt interzise pe Facebook. Nu sunt raportate prea mult, dar dacă cineva le raportează, este necesar să fie şterse” explică ei. „Nici măcar nu poţi numi asasin un soldat israelian care loveşte un copil palestinian. Un astfel de comentariu, de asemenea, este nevoie să-l ştergi.”

Înainte de a deveni analişti ai Facebook, lucrătorii fac un antrenament de două săptămâni pentru a-şi însuşi politicile de cenzură şi a face practică pe exemple. „În una dintre aceste sesiuni”, povesteşte Johan, „o fată a întrebat ce este sionsimul”. Răspunsul a fost că era „o minoritate persecutată în Palestina şi, deci, orice comentariu împotriva sionismului este necesar să fie eliminat”. În nicio politică publică a Facebook nu se regăsește această formulare, şi în normele interne nu este atât de clar în scris, dar sursele consultate asigură că acest climat este cel care se respiră zilnic la locul de muncă şi, prin urmare, are o influenţă directă asupra deciziilor care sunt luate în biroul de la Varşovia.

Cum defineşte Facebook terorismul? „Actele premeditate de violenţă împotriva persoanelor sau a proprietăţii pentru a intimida populaţia civilă, guvernul sau organizaţiile internaţionale, cu scop politic, religios sau ideologic.” Unde pune limita Facebook? Unde spun SUA. Lucrătorii au acces la o listă a organizaţiilor teroriste elaborată de guvernul SUA. „Dacă un comentariu laudă o organizaţie sau cineva preia fotografia emblemei sale şi această organizaţie este pe listă, ştergem” … „Acest aspect ridică probleme”, explică lucrătorii. „Există utilizatori care postează comentarii pe Facebook referitoare la anumite persoane sau grupuri, deoarece le consideră eroi ai grupurilor politice armate, care în multe ţări nu sunt consideraţi terorişti, ci gherilă sau soldaţi sau lideri, dar pe lista americanilor apar ca teroriste.” Ne-au fost date și exemple: Hamas în Palestina sau PKK în Turcia. Hamas nu este considerat un grup terorist de către Uniunea Europeană, care are propria sa listă de organizații teroriste. Dar ceea ce contează este lista SUA.

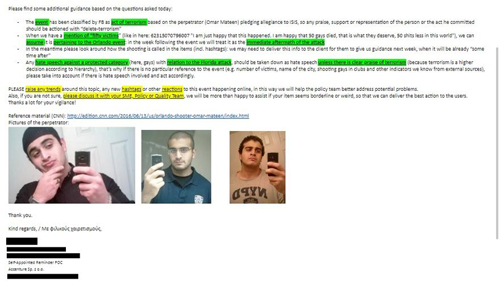

Pentru a lua decizii privind un act de război sau despre un atac terorist, moderatorii este necesar să fie bine informaţi despre ce se petrece în fiecare zi în lume. Şefii îi avertizează prin e-mail despre evenimente care probabil le vor da de lucru: „Împuşcături într-o biserică din apropiere de Cairo, tot conţinutul ce arată atacul sau îl elogiază e necesar să fie eliminat. Clasificăm actul drept atac terorist,” spune un superior al analiştilor într-un e-mail intern la care a avut acces eldiario.es. (…)

„Facebook apară interpretarea politică pe care o are SUA în lume”, spun Albert, Johan şi de asemenea María. „Şi celelalte ţări, nu contează”. Această asimetrie se aplică nu numai problemelor politice. „Am văzut videoclipuri ale copiilor din ţările arabe spunând în filme pe Facebook că se vor sinucide; aceasta nu este o problemă pentru Facebook. Dar dacă afirmația este făcută de un copil în SUA sau în Europa, ei anunţă autorităţile”, aşa cum compania promite că va face fără distincţie în normele sale publice. (…)

Dacă un mic grup de elevi ai unui institut fac bullying (comportament ostil/de excludere și de luare în derâdere a cuiva, de umilire) prin Facebook, probabil alţi colegi nu îndrăznesc să-i denunţe şi tac. Deci bullying persistă. „În plus, ca să putem şterge cuiva profilul, şi nu numai conţinutul, este nevoie să încalce normele în peste 30% din postări”, explică Johan. „Să fim realişti: dacă am elimina toate profilele care hărțuiesc, reîmpart pornografie sau vând marihuana pe Facebook, ar fi nevoie să ştergem multe profile. Şi Facebook nu vrea să rămână fără utilizatori.”

Precaritate şi traume: „Întâlnim aspecte care nu te-ar lăsa să dormi”

„Noi acordăm toată valoarea muncii grele a revizorilor noştri de conţinut”, spune un purtător de cuvânt al Facebook la eldiario.es. „Toată lumea primeşte un salariu peste standardul de piaţă.” Angajaţii Facebook din Barcelona, Varşovia sau Lisabona sunt angajaţi prin intermediul unor companii de servicii pentru clienţi, cum ar fi Competence Call Center din Barcelona. Acest aspect permite companiei să se distanţeze legal de condiţiile sale de muncă, precum şi să crească, dar şi să reducă forţa de muncă cu lucrători temporari. Salariul variază în diverse birouri şi în diverse părţi din lume, pentru a se adapta la piaţa muncii din ţara respectivă a populaţiei imigrante care stăpâneşte diferite limbi de care este nevoie, ceea ce permite relocarea şi salarii mai mici.

În fiecare centru, un grup de şefi analizează aleatoriu între 5% şi 10% din cazurile moderate de lucrători pentru a verifica dacă deciziile sunt conforme cu ceea ce li se cere. „Scopul este de a avea cel puţin 98% succes în fiecare lună”, spune Johan. „Dacă nu le ai, opţiunile de a urca o treaptă mai sus în funcţie sau de a primi bonusuri trimestriale sau lunare, se duc de râpă”, continuă el. Bonusurile nu depăşesc de obicei 100 de euro pe lună.

Majoritatea moderatorilor Facebook sunt persoane tinere, fără o calificare specială, expuşi zilnic la ore de conţinut extrem de deranjant. „Există un psiholog pentru echipa de operatori, dar nu este obligatoriu să fie consultat… Venim în contact cu aspecte foarte puternice şi într-un ritm foarte stresant”, spune Johan. Pedofilia, crimele, hărțuirea de tot felul şi discursul de ură în toate direcţiile. Lucrătorii nu rezistă mult în post, de obicei pleacă repede, saturaţi. „Este o muncă foarte dură: am lucrat o lună şi ieşeam de acolo cu capul praf. Aceste 8 ore, cronometrate, consumând non-stop video şi fotografii în care de multe ori există pedofilie, atacuri asupra minorilor și animalelor… Plata este infimă”, spune María despre experienţa ei în biroul de la Lisabona.

Unii lucrători au întreprins deja acţiuni în justiţie împotriva Facebook pentru provocarea daunelor psihologice derivate din sindromul stresului post-traumatic. Site-ul american de știri The Verge a publicat un amplu raport despre ororile pe care le trăiesc lucrătorii într-un alt centru Facebook, în Phoenix (SUA).

Bonusurile lucrătorilor depind de rezistenţa lor la vizionarea videoclipurilor pe care ulterior le vor cenzura sau nu. „Am văzut creiere împrăştiate, am văzut copii morţi, am văzut soldaţi bătând civili până la moarte”, spune Johan. „Dacă nu eşti suficient de puternic pentru a viziona videoclipul până la sfârşit şi iei o decizie sub presiune, va avea consecinţe asupra calităţii muncii”, ceea ce înseamnă mai puţine prime şi compensaţii la sfârşitul lunii. De exemplu, „dacă cineva este în foc într-un film, tocmai l-am marcat ca cenzurat pentru copii sub 18 ani. Dar, în cazul în care o persoană moare în film ca urmare a acelui foc, e necesar să-l ştergi. Deci, este necesar să fie urmărit video-ul până la sfârşit”.

Citiți și:

După dezmințiri repetate, Facebook recunoaște acum că angajații săi au cenzurat anumite site-uri de știri

Facebook, controlat de israelieni, obligat să restaureze drepturile omului

Companiile tehnologice mari conspiră întru cenzură

yogaesoteric

13 septembrie 2020