La police britannique teste un système d’IA pour établir le profil des individus à partir de données sensibles provenant de 80 sources

Les forces de police britanniques ont commencé à acquérir un logiciel d’intelligence artificielle auprès d’une entreprise technologique américaine qui fusionne des données personnelles sensibles, telles que l’origine ethnique, la santé, les opinions politiques, les croyances religieuses, la sexualité et l’appartenance syndicale, dans une plateforme de renseignement unifiée.

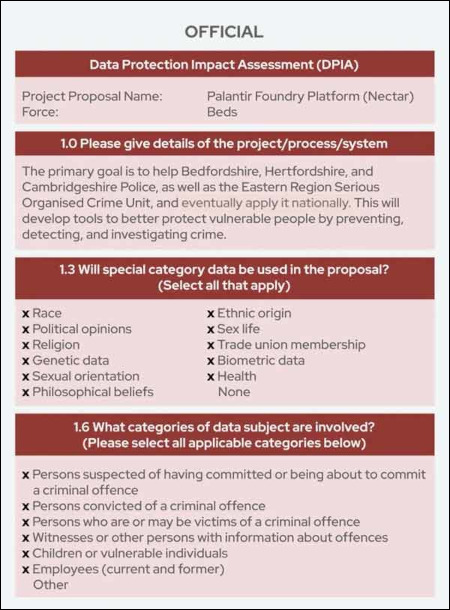

Une note interne de la police du Bedfordshire, obtenue grâce à la loi sur la liberté d’information, révèle des plans visant à déployer le système « Nectar » au-delà de sa phase pilote.

Développé en partenariat avec Palantir Technologies, Nectar rassemble environ 80 flux de données, provenant notamment de caméras de surveillance routière et de fichiers de renseignements, au sein d’une plateforme unique. Son objectif déclaré est de générer des profils détaillés des suspects et de faciliter les enquêtes impliquant des victimes, des témoins et des groupes vulnérables, y compris des mineurs.

Le briefing de 34 pages souligne que les responsables de la police espèrent étendre le déploiement du logiciel du Bedfordshire et de l’unité chargée de la criminalité organisée grave de la région Est à l’échelle nationale, a rapporté Liberty. Il affirme que le système pourrait renforcer les efforts de prévention de la criminalité et protéger plus efficacement les personnes à risque.

Cette initiative s’inscrit dans le cadre d’un programme gouvernemental plus large visant à appliquer l’intelligence artificielle à l’ensemble des services publics, notamment la santé et la défense, souvent par le biais de partenariats avec le secteur privé comme celui-ci.

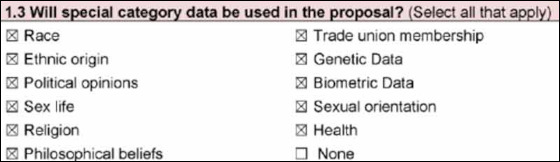

Cependant, le déploiement de Nectar, qui accède à onze types de données « de catégorie spéciale », a suscité l’inquiétude des défenseurs de la vie privée et de certains législateurs. Ces catégories comprennent l’origine ethnique, l’orientation sexuelle, les opinions politiques et l’appartenance à un syndicat.

Bien que Palantir et la police du Bedfordshire soulignent que Nectar utilise uniquement des informations déjà contenues dans les bases de données existantes des forces de l’ordre et reste inaccessible au personnel non policier, les inquiétudes grandissent. On craint notamment des abus potentiels, tels que la conservation des données sans processus de suppression approprié, et le risque que des personnes innocentes soient signalées par des algorithmes conçus pour identifier les réseaux criminels.

L’ancien ministre de l’Intérieur du cabinet fantôme, David Davis, a tiré la sonnette d’alarme dans I Magazine, appelant à un contrôle parlementaire et avertissant qu’une « absence totale de surveillance » pourrait conduire la police à « s’approprier les pouvoirs qu’elle souhaite ».

Liberty et d’autres militants se sont également interrogés sur le fait de savoir si Nectar constituait effectivement un outil de surveillance de masse, capable d’établir des profils détaillés « à 360 degrés » sur les individus.

En réponse, un porte-parole de la police du Bedfordshire a déclaré que cette initiative était un « exercice exploratoire » axé sur des données obtenues légalement et traitées de manière sécurisée.

Il affirme que le système accélère le traitement des dossiers et facilite les interventions en cas d’abus ou d’exploitation, en particulier chez les enfants. Palantir a ajouté que dans les huit premiers jours suivant son déploiement, Nectar avait permis d’identifier plus de 120 jeunes potentiellement en danger et facilité l’application des notifications prévues par la loi Clare.

Palantir, qui a développé Nectar à l’aide de sa plateforme de données Foundry, insiste sur le fait que son logiciel n’introduit pas de police prédictive ni de profilage racial et n’ajoute pas de données au-delà de celles déjà collectées par la police. L’entreprise affirme que son rôle se limite à l’organisation des données et non à la prise de décision.

Pourtant, les experts expriment une profonde inquiétude.

Bien que le déploiement national n’ait pas encore été autorisé, le ministère de l’Intérieur confirme que les résultats du projet pilote serviront de base aux décisions futures. Avec l’intégration croissante des outils d’IA du secteur privé dans les activités policières, les questions relatives à la surveillance, à la transparence, à la suppression des données et aux droits individuels prennent de plus en plus d’importance.

yogaesoteric

24 juin 2025