Google va introduire des « interventions » comportementales

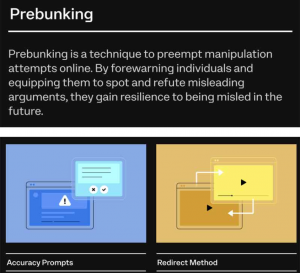

La prochaine idée dystopique, y compris des propositions telles que le « prebunking ».

Google a présenté son projet baptisé « Info Interventions », qui repose sur une science comportementale qui, si ces « interventions » sont utilisées comme prévu, pourrait « enseigner » aux utilisateurs à devenir résistants aux préjudices en ligne.

Une autre promesse est qu’en « prebunkisant la mésinformation », les utilisateurs peuvent être « immunisés ».

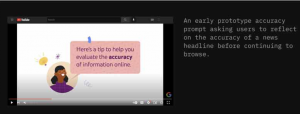

Comment cela est-il censé fonctionner ? Google a mis en ligne un site qui indique que l’objectif est de fournir des invites d’exactitude qui recentreraient l’attention des utilisateurs vers ce que Google considère comme des informations exactes.

Et pour y parvenir, l’« hypothèse » semble actuellement être que « rappeler aux individus de penser à l’exactitude lorsqu’ils sont sur le point de s’engager avec de fausses informations peut renforcer les objectifs d’exactitude préexistants des utilisateurs ».

Cette méthode visant à former efficacement les utilisateurs à se comporter d’une manière souhaitée tente sans surprise de s’inspirer de la recherche en sciences comportementales et Google affirme qu’elle a été validée par des expériences numériques.

Ce « cadeau au monde » est le fruit de l’unité de Google appelée Jigsaw, créée pour « explorer les menaces qui pèsent sur les sociétés ouvertes et construire une technologie qui inspire des solutions évolutives. »

Dans un article publié sur Medium en mars 2021, Jigsaw déclare que les recherches suggèrent qu’il pourrait y avoir un moyen puissant de réduire la « mésinformation » simplement en rappelant aux internautes de penser à l’exactitude – en d’autres termes, en les aiguillonnant jusqu’à ce qu’ils aillent là où vous voulez qu’ils aillent.

On tente même de culpabiliser les utilisateurs en leur faisant croire qu’ils contribuent à répandre la « mésinformation en étant enclins aux distractions », alors que le fait d’avoir à l’esprit l’exactitude telle que définie par Google pourrait réduire ce phénomène.

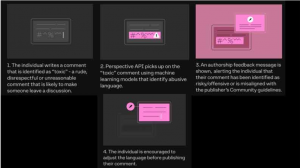

Actuellement, explique Google sur sa page « Interventions », si un utilisateur fait défiler un flux, il peut rencontrer de la « mésinformation potentielle ».

Cela activerait alors « une invite d’exactitude » qui couvrirait partiellement l’information déjà étiquetée comme étant de la mésinformation.

Le message d’invite contient une brève explication sur la raison pour laquelle l’utilisateur le voit, mais en général, l’attention de l’utilisateur est maintenant censée passer du contenu qu’il voulait voir au message en question, ce qui signifie qu’il sera dirigé vers l’« exactitude » à la place.

Ils seront également soumis à ce qu’on appelle des conseils de maîtrise de l’information.

Ainsi préparé, l’attention de l’utilisateur se concentre sur le « rappel », le contenu restant loin derrière. Plus important encore, pour Google, la prochaine fois qu’il rencontrera un contenu similaire, on espère qu’il « réfléchira à deux fois » (sans doute avant de s’y engager).

Passons maintenant aux résultats de ces expériences qui, selon Google (Jigsaw), ont été menées en collaboration avec le MIT et l’Université de Regina :

« Ceux qui ont reçu des conseils de précision étaient 50% plus perspicaces dans leurs habitudes de partage que les utilisateurs qui n’en ont pas reçu » – et, « Les vidéos pré-roll sur YouTube ont entraîné une augmentation de 11% de la confiance, trois semaines après l’exposition. »

Voir tous les détails ici.

yogaesoteric

13 février 2023