La police secrète de Google pour réguler la « liberté d’expression » sur internet

Plus de 100 organisations non gouvernementales (ONG) et organismes gouvernementaux du monde entier aident YouTube à supprimer les contenus extrémistes sur YouTube, allant du soi-disant discours de haine aux vidéos de recrutement de terroristes.

Tous ont des accords de confidentialité empêchant Google, la société mère de YouTube, de révéler leur participation au public, a déclaré le 18 janvier 2018 un représentant de Google à The Daily Caller.

Une poignée de groupes, dont la Anti-Defamation League et No Hate Speech, une organisation européenne axée sur la lutte contre l’intolérance, ont choisi de rendre publique leur participation au programme, mais la grande majorité d’entre eux sont restés cachés derrière les accords de confidentialité. La plupart des groupes du programme ne veulent pas y être publiquement associés, selon le porte-parole de Google, qui ne s’exprimait que sur le fond.

Le programme « Trusted Flaggers » de YouTube remonte à 2012, mais la taille du programme a explosé ces dernières années dans le cadre d’une campagne de Google visant à accroître la réglementation du contenu sur ses plateformes, qui a suivi la pression des annonceurs. Cinquante des 113 membres du programme se sont joints à YouTube en 2017, alors que celui-ci a intensifié ses activités de maintien de l’ordre, a déclaré le directeur des politiques publiques de YouTube, Juniper Downs, devant un comité sénatorial.

Les groupes tiers collaborent étroitement avec les employés de YouTube pour réprimer le contenu extrémiste de deux façons, a déclaré M. Downs et un porte-parole de Google l’a confirmé. Tout d’abord, ils sont équipés d’outils numériques leur permettant de signaler le contenu en masse pour qu’il soit examiné par le personnel de YouTube. Deuxièmement, les groupes partenaires servent de guides aux moniteurs de contenu et aux ingénieurs de YouTube qui conçoivent les algorithmes de YouTube, mais qui n’ont peut-être pas l’expertise nécessaire pour aborder un sujet donné.

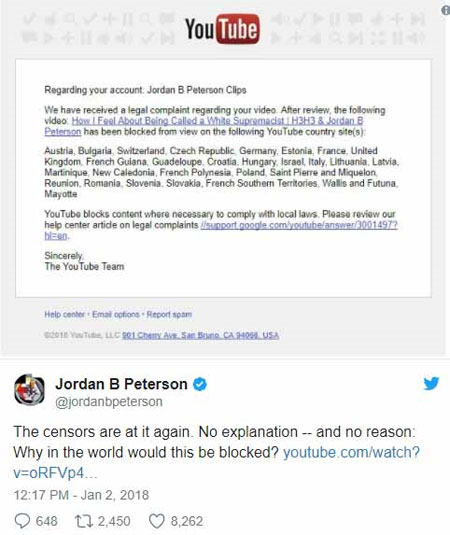

Ce ne sont pas seulement les vidéos terroristes que Google censure. Jordan B. Peterson, un professeur connu pour s’être opposé au politiquement correct, avait bloqué une de ses vidéos dans 28 pays au début du mois de janvier 2018. Une note envoyée au compte de Peterson disait que YouTube avait « reçu une plainte juridique » au sujet de la vidéo et avait décidé de la bloquer.

Peterson s’est servi de ses grands médias sociaux pour pousser en arrière, appelant YouTube sur Twitter, où il a plus de 300.000 abonnés. YouTube a supprimé le blocage de Peterson après qu’un autre YouTuber populaire, Ethan Klein, a demandé une explication sur Twitter, où il a plus d’un million d’abonnés. Bien que l’avis original indiquait que YouTube répondait à une plainte juridique, sur Twitter, la société donnait l’impression que le blocage était une erreur.

La grande majorité des contrôles de contenu sur Google et YouTube sont effectués par des algorithmes. Les algorithmes permettent de réfuter facilement les accusations de partialité politique : ce n’est pas nous, c’est l’algorithme. Mais les algorithmes sont conçus par des gens. Comme indiqué ci-dessus, les partenaires externes anonymes de Google collaborent étroitement avec les experts internes qui conçoivent les algorithmes. Cette étroite collaboration a de nombreux avantages, disent les représentants de Google, en soulignant les avancées dans la lutte contre la propagande terroriste sur la plate-forme. Mais elle fournit aussi peu de transparence, forçant les utilisateurs à croire Google sur parole que tous les signalements sont traités équitablement.

Le partenariat de YouTube avec des organisations extérieures pour lutter contre les contenus extrémistes n’est qu’une partie des efforts de l’entreprise pour donner la priorité à certains types de contenu sur d’autres. YouTube supprime également certains contenus grâce à son mode « restreint », qui permet d’afficher des vidéos qui ne conviennent pas aux enfants ou qui contiennent des contenus « potentiellement matures », ainsi qu’en démontrant certaines vidéos et chaînes, coupant ainsi le flux financier à leurs opérateurs.

Prager University, une organisation à but non lucratif conservatrice qui réalise des vidéos éducatives, a poursuivi Google en octobre pour avoir à la fois mis leur contenu en mode restreint et l’avoir démonétisé. Prager fait face à une rude bataille devant les tribunaux (en tant que société privée, Google n’est pas lié au Premier amendement) mais la poursuite a obligé Google à adopter des positions publiques sur cette censure.

« Le représentant de Google qui s’est entretenu avec TheDC a déclaré que ce sont les algorithmes qui sont responsables du placement des vidéos en mode restreint. Mais dans les documents judiciaires examinés par TheDC, les avocats de Google soutenaient le contraire. Les décisions au sujet desquelles les vidéos entrent dans cette catégorie sont souvent compliquées et peuvent faire appel à un jugement difficile et subjectif », ont-ils soutenu dans des documents déposés le 29 décembre 2017.

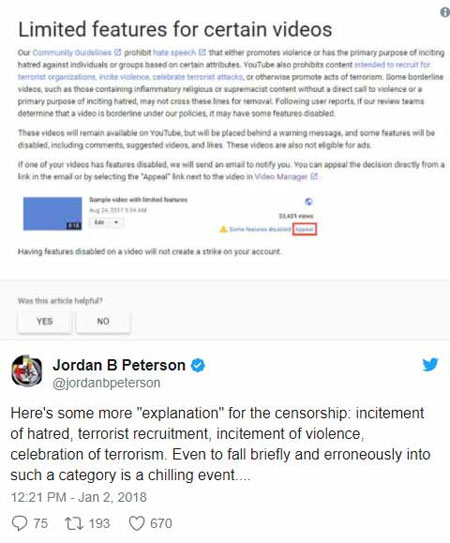

Dans son témoignage devant le comité sénatorial, Mme Downs a décrit certaines des mesures prises par Google pour supprimer le contenu « offensif » ou « dérangeant » qui n’est pas à la hauteur de l’extrémisme violent.

« Certaines vidéos au contenu limite, comme celles qui contiennent des contenus religieux incendiaires ou suprémacistes sans appel direct à la violence ou dans le but premier d’inciter à la haine, peuvent ne pas franchir ces limites pour être retirées. Mais nous comprenons que ces vidéos peuvent être offensantes pour beaucoup et nous avons mis au point un nouveau traitement pour elles », a-t-elle dit.

« Les contenus limites identifiés resteront sur YouTube après un interstitiel, ne seront pas recommandés, ne seront pas monétisés et n’auront pas de caractéristiques clés, y compris des commentaires, des suggestions de vidéos et des préférences. Les premières utilisations ont été positives et ont montré une réduction substantielle du temps de visionnage de ces vidéos », a-t-elle ajouté.

La campagne de démonétisation de YouTube, qui touche certaines des chaînes politiques non gauchistes les plus populaires, a pour but d’accommoder les annonceurs qui cherchent à éviter les contenus controversés, a déclaré le porte-parole de Google.

Dave Rubin, un animateur populaire de YouTube, a vu ses vidéos être démonétisées à plusieurs reprises. Rubin a posté une vidéo, « Le socialisme n’est pas cool », le 17 janvier 2018. La vidéo était en ligne un peu plus de 24 heures avant que YouTube ne la démonétise le 18 janvier 2018.

La monétisation a été réactivée par la suite sur Youtube, a confié un représentant de Google à TheDC. Mais les utilisateurs ne peuvent pas récupérer les fonds publicitaires qu’ils ont perdus pendant que leurs vidéos étaient démonétisées par erreur.

Il y a définitivement un penchant politique, une conspiration est à l’oeuvre pour empêcher certaines personnes de gagner leur vie avec des propos controversés bien que non haineux, et de suivre une politique clairement gauchiste libérale démocrate.

yogaesoteric

2 février 2020