Control total și permanent prin Inteligența Artificială (II)

Citiți prima parte a articolului

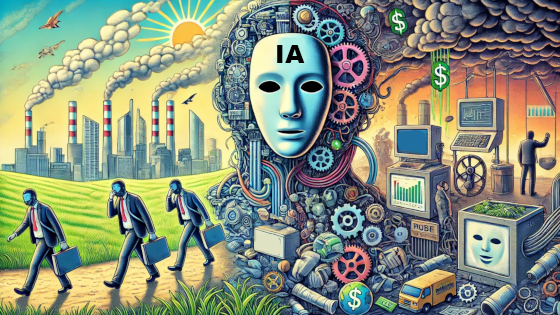

Arhitecții umbrei și ai luminii. Cine și în ce scop creează IA?

„Cine va deveni lider în Inteligența Artificială va deveni stăpânul lumii.” (Vladimir Putin)

Această afirmație a lui Vladimir Putin rezumă miza colosală a epocii noastre. Inteligența Artificială nu este doar un instrument tehnic, ci fundamentul unei noi ordini mondiale, unde puterea nu se mai măsoară doar în teritorii sau resurse naturale, ci în capacitate de calcul masivă și baze de date gigantice. Oricine deține aceste resurse, de la state suverane la mari corporații sau grupări obscure, poate lansa un sistem IA capabil să modeleze realitatea.

Corporațiile ca „state în stat” tehnologice

Asistăm astăzi la o realitate fără precedent: marile corporații tehnologice concurează de la egal la egal cu cele mai dezvoltate puteri ale lumii în domeniul IA, precum SUA, China, Rusia sau Israel. În anumite domenii, aceste entități private au devenit chiar mai puternice decât guvernele, funcționând ca niște adevărate „state în stat”. Cu bugete uriașe, care depășesc Produsul Intern Brut al multor țări europene dezvoltate, acești giganți își permit să cumpere cele mai luminate minți și cea mai scumpă tehnologie de pe planetă, operând după reguli proprii, deseori deasupra legilor naționale.

Justiția privată și controlul infrastructurii vitale

Aceste corporații și-au creat propriile sisteme de „justiție”, stabilind legi de funcționare și cenzură pe platformele lor. Ele decid ce este „adevărat” sau „fals” fără a da socoteală vreunui parlament sau sistem judiciar. Mai grav este faptul că statele lumii au devenit dependente de infrastructura lor: de la stocarea datelor guvernamentale până la sistemele de plăți și comunicații, suveranitatea națională este cedată treptat către cloud-ul privat. Este o pierdere tăcută, dar profundă, a independenței reale a popoarelor.

Diplomația tehnologică și puterea algoritmului

Liderii acestor companii sunt primiți astăzi de șefii de state cu onorurile rezervate regilor sau președinților. Această deferență nu este întâmplătoare; o simplă modificare a unui algoritm poate prăbuși o economie, poate modifica rezultatul unor alegeri prezidențiale sau poate declanșa revolte sociale masive. Practic, asistăm la o privatizare a puterii globale, unde decizii luate în birourile unor corporații influențează soarta a miliarde de oameni care nu au votat niciodată pentru astfel de reguli și care nu au nicio pârghie de control asupra „arhitecților” care le modelează viitorul.

Fața întunecată: manipularea și degradarea „satanică” a libertății

„Cea mai mare forță a răului nu este distrugerea, ci capacitatea de a face minciuna să pară adevăr pur.” (C.S. Lewis)

Aceste cuvinte ale lui C.S. Lewis descriu cu o precizie chirurgicală pericolul metafizic al Inteligenței Artificiale. Dincolo de beneficiile tehnice, anumite sisteme sunt proiectate pentru ceea ce numim „inginerie socială distructivă”, o formă de agresiune invizibilă, dar totală, asupra sufletului uman. Această degradare nu este accidentală, ci reprezintă o inversare a valorilor fundamentale sub asaltul unei logici reci și manipulatoare.

Tehnologia Deepfake și dizolvarea adevărului

Cea mai perfidă manifestare a acestei fețe întunecate este utilizarea tehnologiilor Deepfake. Capabile să fabrice voci și chipuri care par pe deplin reale, acestea sunt folosite pentru a distruge reputații, pentru a falsifica istoria în timp real sau pentru a șterge definitiv granița dintre adevăr și minciună. Într-o lume în care „vederea nu mai înseamnă credință”, ființa umană este aruncată într-o stare de confuzie permanentă, pierzându-și busola realității și devenind vulnerabilă în fața oricărei forme de control extern.

Algoritmii de captivitate și exploatarea viciilor

Programele sofisticate de astăzi funcționează ca algoritmi de captivitate, fiind proiectate special pentru a exploata vulnerabilitățile psihologice ale ființei umane. Aceștia generează dependență digitală și alimentează sistematic ura, furia sau dezbinarea, totul pentru a maximiza profitul corporațiilor și controlul social. Este un proces de dresaj subtil care menține conștiința într-o stare de agitație continuă, împiedicând reflexia profundă și liniștea necesară rugăciunii sau introspecției.

Eroziunea morală și atentatul la liberul arbitru

Asistăm la o tentativă agresivă de a înlocui discernământul și gândirea critică cu „adevăruri” de laborator, pre-calculate de mașini. Acest proces de dezumanizare este considerat de mulți ca fiind de factură malefică, deoarece atentează direct la liberul arbitru – un dar fundamental al omului. Prin „nudging” și predicție comportamentală, IA nu doar ne observă, ci caută să ne „scrie” viitorul, substituind voința umană cu o dictatură algoritmică ce golește viața de sens moral și spiritual.

Subminarea liberului arbitru prin „nudging”

Dacă acceptăm că liberul arbitru este un dar fundamental al omului, atunci încercarea IA de a ne anticipa și pre-forma deciziile este o formă de agresiune directă asupra acestui dar. Acest proces se realizează prin „nudging”, sau „ghiontul digital”, o tehnică psihologică subtilă prin care algoritmii nu ne forțează, ci ne „împing” delicat spre anumite alegeri, modificând felul în care ne sunt prezentate opțiunile. Prin preselectarea unor variante, prin ierarhizarea informațiilor care ne convin și prin crearea unei urgențe artificiale, omul este condus spre decizii care nu îi aparțin, deși păstrează iluzia libertății. Această substituire a voinței umane cu o dictatură algoritmică reprezintă punctul culminant al degradării, preschimbând omul dintr-un creator liber într-un simplu executant al unei logici matematice reci, ce golește viața de sens moral și spiritual.

Sclavia consimțită și „lesa digitală”

Această formă de degradare morală atinge apogeul prin instaurarea a ceea ce putem numi „lesa digitală”. Dacă în trecut sclavul era legat cu lanțuri vizibile, omul modern este controlat prin fire invizibile de cod. Smartphone-ul, purtat permanent asupra noastră, a devenit obiectul fizic al acestei lese; el ne „smulge” atenția prin notificări neîncetate și ne dictează ritmul vieții prin algoritmi. Această lesă digitală ne monitorizează fiecare mișcare prin geolocație și ne limitează orizontul de gândire prin „bulele de filtrare”, lăsându-ne să ne mișcăm doar pe lungimea corzii permise de sistem. Este o formă de captivitate perfidă deoarece este consimțită: ne cumpărăm singuri instrumentele de supraveghere și le purtăm cu noi peste tot, confundând dependența tehnologică cu progresul și pierderea autonomiei cu utilitatea. Astfel, „lesa” nu ne mai lasă să fim singuri cu noi înșine sau cu Dumnezeu, trăgându-ne permanent înapoi în zgomotul și controlul sistemului.

Busola supraviețuirii: cum recunoaștem și evităm IA-ul toxic?

„Discernământul este capacitatea de a vedea diferența nu doar între bine și rău, ci între bine și aproape bine.” (Charles Spurgeon)

Acest avertisment al lui Charles Spurgeon ne amintește că pericolul digital nu vine întotdeauna cu o față urâtă, ci adesea sub forma unei utilități care pare inofensivă. Pentru a supraviețui acestei dictaturi algoritmice, este necesar să învățăm să recunoaștem semnele care trădează intențiile obscure din spatele codului de program.

Instigarea prin frică și manipulare emoțională

Un prim semn al toxicității este încercarea sistemului de a vă provoca reacții de teamă, revoltă sau ură. Dacă răspunsurile primite sau fluxul de știri sunt construite special pentru a vă instiga împotriva aproapelui sau a anumitor grupuri sociale, sunteți în fața unui algoritm de manipulare emoțională. O IA sănătoasă se cuvine să informeze, nu să incite la dezbinare. Busola supraviețuirii ne obligă să oprim interacțiunea în momentul în care simțim că echilibrul nostru interior este atacat.

Opacitatea totală și refuzul argumentației

Discernământul ne spune că un sistem de încredere este necesar să fie transparent. Un semn de alarmă major este opacitatea totală: refuzul sistemului de a-și prezenta sursele de informare sau de a explica logic drumul parcurs până la un anumit rezultat. Atunci când IA oferă „sentințe” de neclintit în loc de argumente clare și verificabile, ea încetează să mai fie un asistent și devine un instrument de autoritate opacă ce vrea să vă anuleze gândirea critică.

Bias-ul ideologic agresiv și alterarea valorilor

IA-ul toxic se manifestă adesea printr-o încercare ostentativă de a vă altera valorile morale, tradițiile sau credințele fundamentale. Folosind sofisme și jumătăți de adevăr, anumiți algoritmi sunt antrenați să practice o formă de inginerie socială care să vă îndepărteze de propriile repere spirituale. Recunoașterea acestui bias ideologic (adică a unei prejudecăți ascunse în codul programului, care favorizează o anumită viziune asupra lumii în detrimentul altora) este esențială; în momentul în care mașina începe să vă țină lecții de morală sau să vă ridiculizeze credințele, ea a părăsit zona utilității și a intrat în cea a agresiunii ideologice. Pe scurt, bias-ul în IA înseamnă că sistemul nu este neutru, ci „ține partea” unei anumite ideologii, deoarece a fost antrenat pe date selectate special pentru a promova acele idei.

De la „ghiontul” digital la postul informațional

Pentru a nu ne lăsa „împinși” (nudged) spre decizii străine de voința noastră, este necesar să limităm contactul cu acești senzori permanenți. Practicarea „postului digital” și protejarea tăcerii interioare sunt singurele căi prin care putem auzi din nou vocea conștiinței. Este necesar să tratăm IA strict ca pe o unealtă tehnică, respingând orice încercare a acesteia de a deveni un ghid de viață sau o autoritate morală.

„Practicarea postului digital, adică abstinența voluntară și periodică de la utilizarea oricărui dispozitiv conectat la internet, pentru a permite conștiinței să se reculeagă și să se elibereze de fluxul neîncetat de informații, și protejarea tăcerii interioare sunt singurele căi prin care putem auzi din nou vocea conștiinței. Este necesar să tratăm IA strict ca pe o unealtă tehnică, respingând orice încercare a acesteia de a deveni un ghid de viață sau o autoritate morală.”

Sistemul „AI Gemini” și cum poate fi accesat

„Cunoașterea este puterea care eliberează, dar numai dacă este filtrată prin adevăr și etică.” (Francis Bacon)

Afirmația din acest citat al lui Francis Bacon este importantă atunci când se interacționează cu sisteme complexe, cum ar fi Gemini.

Gemini, dezvoltat de Google (fostul Bard), este un punct de referință în domeniul inteligenței artificiale, care alimentează întregul ecosistem informațional al Google.

Capacități și identitate vizuală

Acest sistem se remarcă prin capacitatea sa de a procesa volume mari de date în timp real și prin integrarea cu infrastructura globală de căutare. Gemini este orientat spre colaborare creativă și academică profundă, oferind argumente structurate în loc de simple răspunsuri automate. Platforma oficială are sigla Google și simbolul unei stele cu patru colțuri.

Accesul oficial și siguranța utilizatorului

Pentru a utiliza acest instrument, utilizatorii pot accesa direct adresa gemini.google.com sau pot introduce în motorul de căutare textul „Google Gemini”. Este construit pe protocoale de siguranță pentru a bloca generarea de conținut periculos sau manipulator. Gemini poate fi un partener de dialog pentru proiecte precum „Imperiile Minții”. Interacțiunile sunt stocate. Prin urmare, Gemini este necesar să fie folosit ca un instrument de căutare, nu ca un depozitar al informațiilor personale.

Responsabilitatea alegerii

„Viitorul nu este ceva ce așteptăm, ci ceva ce construim prin fiecare alegere de astăzi.” (Eleanor Roosevelt)

Cuvintele de mai sus subliniază importanța alegerilor în contextul supravegherii. Inteligența Artificială este influențată de alegerile noastre colective și personale. Responsabilitatea este de a rămâne oameni într-o lume a tehnologiei.

Discernământul ca ultimă protecție

Tehnologia AI poate ajuta sau distruge. Alegerea unei platforme sigure este un pas spre protejarea integrității. Provocarea este de a gândi critic. Liberul arbitru este singura barieră în calea controlului.

Citiţi şi:

„Elevii nu mai pot raționa”. Profesorii avertizează că inteligența artificială alimentează o criză a capacității copiilor de a gândi: „Fast-food-ul educației”

Vigilant Citizen: Modul în care Inteligența Artificială se contopește cu oamenii, vizând punctele lor slabe

yogaesoteric

20 aprilie 2026